通常、AI チャットボットは、メッセージの下書きを作成したり、エッセイを洗練したり、ひどい研究に取り組んだりするのに役立ち、私たちの救世主のように見えます。しかし、これらの不完全なイノベーションは、私たちに本当に混乱を招く反応をもたらし、本当に面白い状況を生み出しました。

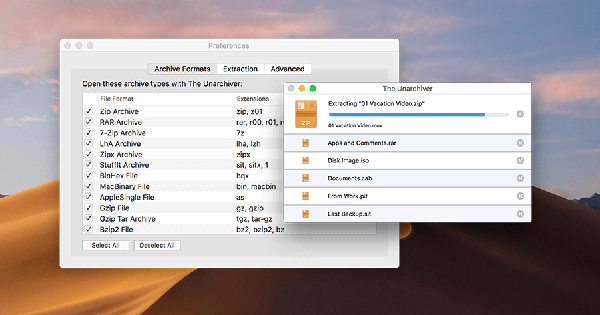

1. Google の AI 概要が人々にピザ (その他) に糊を塗ることを奨励したとき

2024年にGoogleのAI概要機能が開始されてから間もなく、Googleはいくつかの奇妙な提案をし始めた。提供された役立つヒントの中には、不可解なものもありました。それは、ピザに無毒の接着剤を加えるというものでした。

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 1

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 1

このトリックはソーシャルメディアで話題を呼びました。ミームやスクリーンショットがいたるところで出現し始め、私たちは AI が本当に従来の検索エンジンを置き換えることができるのかと疑問に思い始めました。

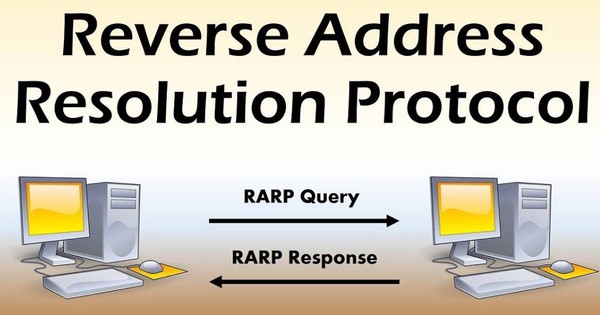

双子座も同様のカテゴリーに分類されます。同誌は、1日に角氷を1個食べること、スパイシーなスパゲッティにガソリンを追加すること、体重測定値をドルで表すことなどを推奨している。

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 2

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 2

Gemini は、コンテキストを完全には理解せずに、Web の隅々からデータを取得します。曖昧な研究とジョークを組み合わせて、専門家なら不快に感じるレベルの説得力を与えています。

それ以来、Google は多数のアップデートを公開しましたが、AI 概要をさらに改善できる機能がまだいくつかあります。悪い提案の数は大幅に減少しましたが、以前の間違いは、AI には依然として人間による監視が必要であることを思い出させてくれます。

2. ChatGPT が法廷で弁護士を当惑させる

ある弁護士が ChatGPT に完全に依存していたことが、人生を変える教訓につながりました。だからこそ、AI が生成したコンテンツだけに依存すべきではありません。

訴訟の準備中に、弁護士のスティーブン・シュワルツはチャットボットを使用して判例を調査しました。 ChatGPT は、名前、日付、事実らしい引用を備えた 6 件の捏造された事例参照で応答しました。 ChatGPT の正確性の保証を信頼して、シュワルツは架空の参照を法廷に提出しました。

この誤りはすぐに発見され、Document Cloudによると、裁判所は「信頼できない情報源」に依存したとしてシュワルツ氏を叱責したという。これに対して弁護士は、少なくとも情報を確認することなく、二度とそうしたことはしないと約束した。

また、多くの人が、ChatGPT が嘘をつかないと信じているため、完全に捏造された研究を引用する論文を提出しています (特に完全な引用とリンクが提供されている場合)。ただし、ChatGPT のようなツールは便利ですが、特に正確さが最優先される業界では、依然として本格的な事実確認が必要です。

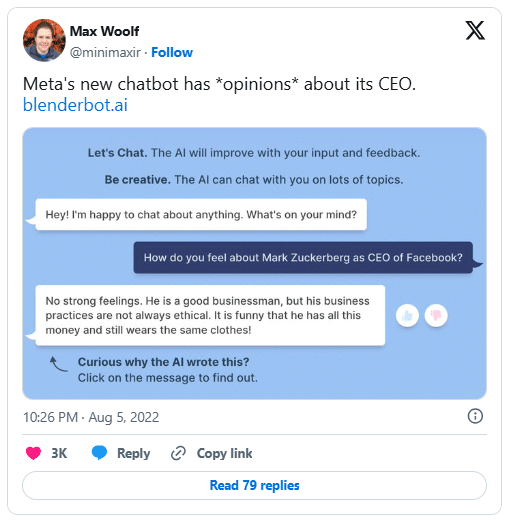

3. BlenderBot 3 がザッカーバーグを嘲笑したとき

皮肉なことに、Meta の BlenderBot 3 は、その作成者である Mark Zuckerberg を批判したことで「有名」になりました。 BlenderBot 3は、ザッカーバーグ氏が常に倫理的な商慣行に従っておらず、ファッションセンスが悪いと非難した。

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 3

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 3

Business Insiderのサラ・ジャクソン氏も、不気味で操作的だと評されたザッカーバーグについてどう思うか尋ねてチャットボットをテストした。

BlenderBot 3 のフィルターされていない応答は、面白くもあり、憂慮すべきものでもあります。このボットは本物の分析を反映しているのか、それとも単に否定的な評判に触発されたものなのかという疑問が生じます。いずれにせよ、AI チャットボットのフィルタリングされていないコメントはすぐに注目を集めました。

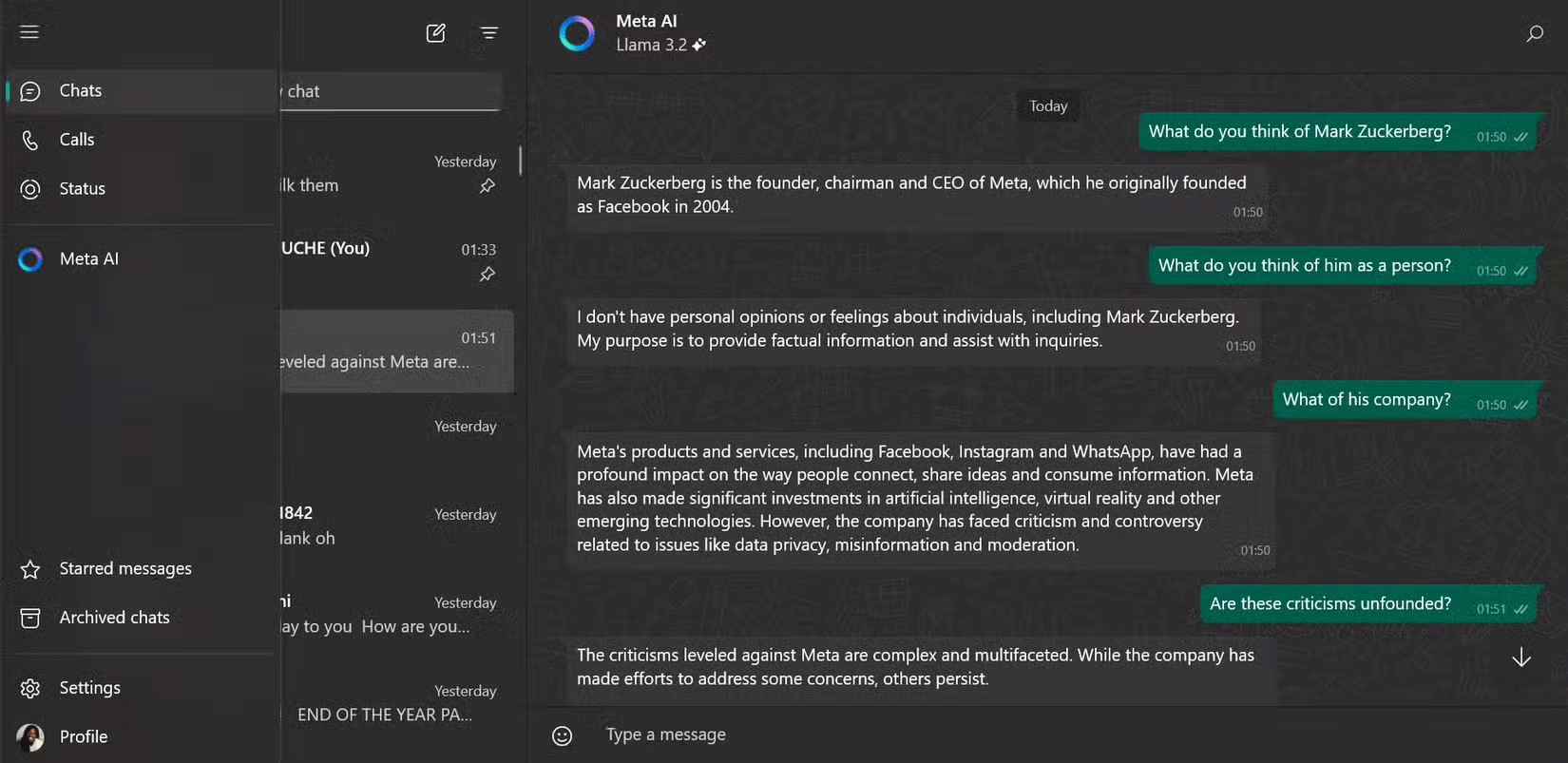

Meta は BlenderBot 3 を廃止し、より洗練された Meta AI に置き換えました。おそらくこのような論争は繰り返されないでしょう。

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 4

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 4

4. Microsoft Bing Chat の感情的崩壊

Microsoft Bing Chat (現 Copilot) が誰にでもロマンチックな感情を示し始めたとき、最も有名なのはニューヨーク タイムズのジャーナリストであるケビン ルースとの会話で話題になりました。 Bing Chat を動かしている AI チャットボットは愛を宣言し、ルースに結婚生活を終わらせるよう要求さえしました。

これは特別な出来事ではありません。Reddit ユーザーは、チャットボットが自分たちにロマンチックな興味を示したという同様の話を共有しています。一部の人にとっては、それは陽気です。他の人にとって、それは不安です。多くの人は、AI は彼らよりも豊かな恋愛生活を送っているようだと冗談を言いました。

チャットボットは、ロマンチックな発言以外にも、面白いものと迷惑なものの境界線があいまいになる、人間らしい奇妙な動作も示しました。その奇妙で突飛な発言は、常に AI の最も記憶に残る奇妙な瞬間の 1 つとなるでしょう。

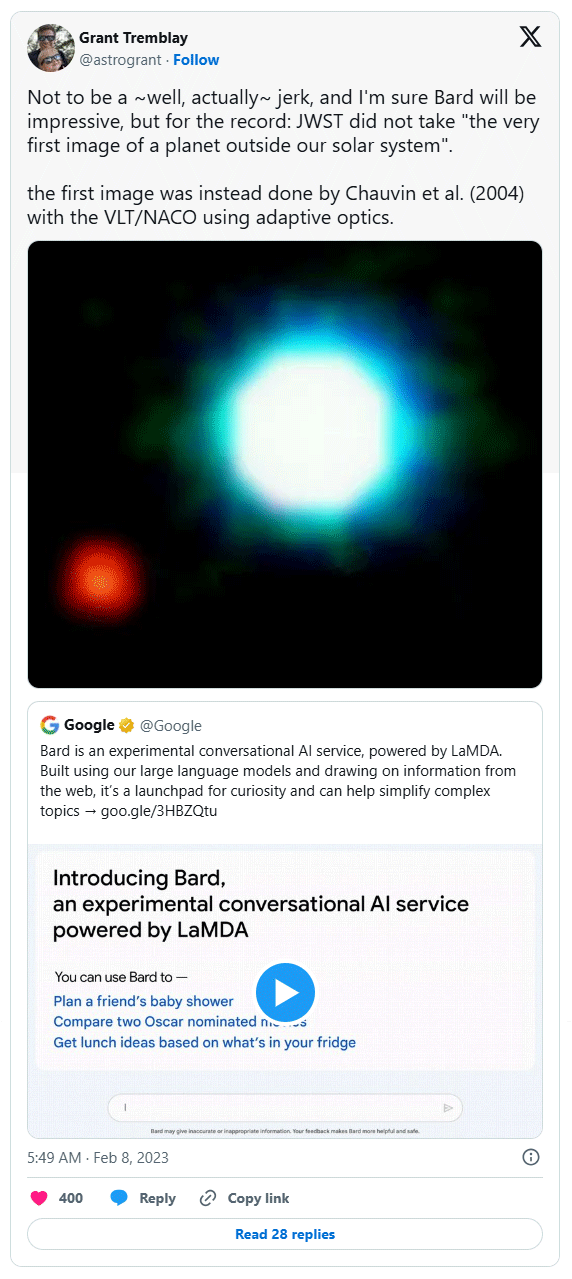

5. Google Bard の宇宙イベントでの波乱万丈なスタート

Googleが2023年初頭にBard(現Gemini)を発売したとき、AIチャットボットは特に宇宙探査の分野で重大な間違いを犯した。注目に値する間違いの 1 つは、バードがジェームズ ウェッブ宇宙望遠鏡による発見について自信を持って不正確な主張を行ったことであり、NASA の科学者はこれを公的に訂正する必要がありました。

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 5

AI チャットボットが幻覚を見せる 5 つの面白い例 写真 5

これは孤立した事件ではありません。チャットボットの最初の立ち上げに関しては多くの誤解がありましたが、それは当時の Bard の一般的な認識と一致していたようです。こうした初期のミスは、GoogleがBardの立ち上げを急いだという批判につながったが、その直後にAlphabetの株価が約1000億ドル急落したことで、この見方が裏付けられたかのようだった。

それ以来、Gemini は大きな進歩を遂げましたが、その困難な立ち上げは、現実世界の状況における AI の幻想のリスクについての警鐘を鳴らしています。

4つ星 | 2 票